Natural Language Processing with Deep Learning CS224N/Ling284

http://web.stanford.edu/class/cs224n/slides/cs224n-2023-lecture11-prompting-rlhf.pdf

Since prompting, instruction tuning, RLHF, ChatGPT etc are such new and fast-moving topics, I haven’t seen many university course lectures covering this content.

So we made some new slides for this year’s CS224n: NLP w/ Deep Learning course at @Stanford!

X@jayelmnop

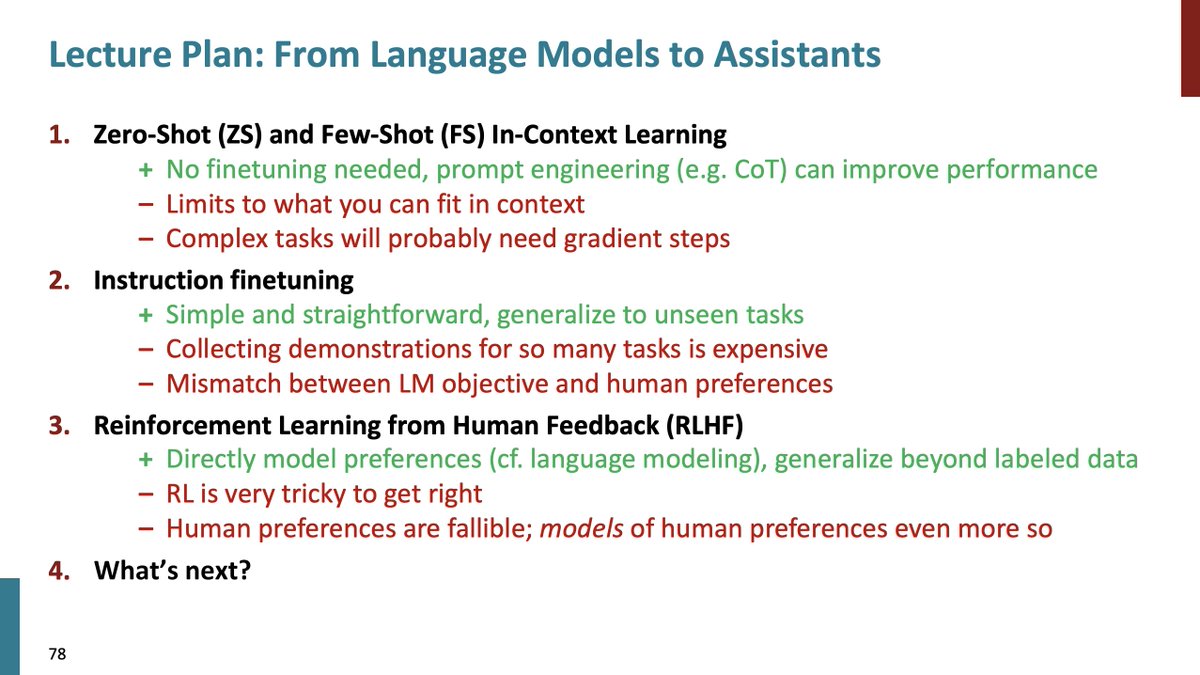

言語モデルからアシスタントへ

- Zero-Shot (ZS) および Few-Shot (FS) の in-context learning

- fine-tuning 不要で、CoT などの prompt engineering により精度向上ができる

- 制限がある(たくさん例示は厳しい)

- 複雑なタスクはまだ出来ない(従来の fine-tuning による勾配更新が必要)

- fine-tuning 不要で、CoT などの prompt engineering により精度向上ができる

- instruction finetuning

- 事前学習済みのLMに対し、多くのタスクに渡る命令と出力のペアを集め、 fine-tuning する

-

-

- シンプルで分かりやすく、未知のタスクへの汎化ができる

- 多くのタスクの例を集めるのはコスト面で高価

- LMと人間の目的が厳密に異なるとき、人間の趣向を明示的に満たせない

- Reinforcement Learning from Human Feedback (RLHF)

- 事前学習 + fine-tuning より高い効果

-

- InstructGPT : RLHF を 30k のタスクに拡張する

- 人間の趣向は信頼できるか怪しい

- Reward modeling の限界

-

- Chatbot だと権威性があり役立ちそうなレスポンスを生成する方向に最適化される

- それが真実かどうかは関係ない

- → ハルシネーション へつながる

- Reward modeling の限界

- What’s Next?

- RLHF はまだデータコストが掛かる

- [Constitutional AI] の登場

-

- [Constitutional AI] の登場

- RLHF はまだデータコストが掛かる

GPT (2018)

- 117M パラメータ

- 12層の Transformer デコーダ

- 4.6GB のテキスト BooksCorpus

GPT-2 (2019)

- 1.5B パラメータ

- 同じアーキテクチャ

- 40GB のテキスト WebText

- Zero-Shot learning

- 例なしで多くのタスクを実行する能力

- 正しいシーケンス予測(Q&A)や、配列の確率の比較など

- GPT-2 はタスクに応じた微調整を行わない言語モデリングにおいてSoTA

- 例なしで多くのタスクを実行する能力

GPT-3 (2020)

- 175B パラメータ

- 600GB 以上のデータ

- Few-Shot learning

- = in-context learning

- タスクの例を前置してタスクを指定

-

-

- これまでの fine-tuning は勾配の更新が伴うが、prompting による擬似的な fine-tuning が勾配の更新なしでできるようになった

-

- ただし、タスクによっては難しい

-

-

- Chain-of-Thought prompting

-

- Zero-Shot の CoT prompting